(Melanoma-Immagine Credit Public Domain).

Il melanoma è di gran lunga la forma più mortale di cancro della pelle che ha ucciso più di 7.000 persone negli Stati Uniti solo nel 2019. La diagnosi precoce della malattia riduce drasticamente il rischio di morte e i costi del trattamento, ma attualmente non è possibile effettuare uno screening diffuso del melanoma. Ci sono circa 12.000 dermatologi praticanti negli Stati Uniti e ciascuno di loro avrebbe bisogno di vedere 27.416 pazienti all’anno per sottoporre l’intera popolazione a screening per lesioni pigmentate sospette (SPL) che possono indicare il cancro.

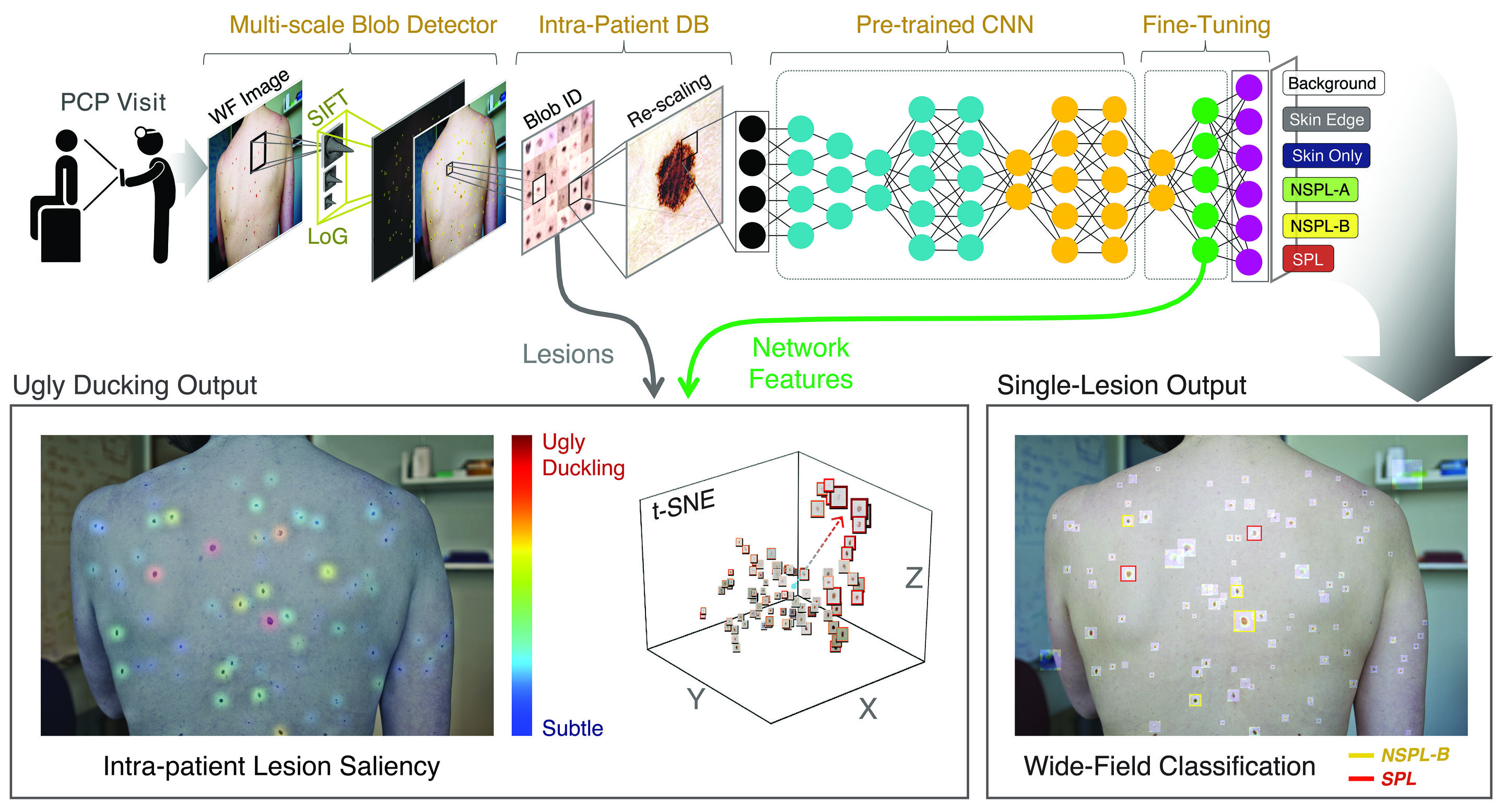

Negli ultimi anni sono stati sviluppati sistemi di diagnosi assistita da computer (CAD) per cercare di risolvere questo problema analizzando le immagini delle lesioni cutanee e identificando automaticamente le SPL, ma finora questi sistemi non sono riusciti a influenzare in modo significativo la diagnosi del melanoma. Questi algoritmi CAD sono addestrati per valutare individualmente ogni lesione cutanea per caratteristiche sospette, ma i dermatologi confrontano più lesioni di un singolo paziente per determinare se sono cancerose, un metodo comunemente chiamato criteri del “brutto anatroccolo”. Nessun sistema CAD in dermatologia, ad oggi, è stato progettato per replicare questo processo diagnostico.

Ora, quella svista è stata corretta grazie a un nuovo sistema CAD per lesioni cutanee basato su reti neurali profonde convoluzionali (CDNN) sviluppato dai ricercatori del Wyss Institute for Biologically Inspired Engineering dell’Università di Harvard e del Massachusetts Institute of Technology (MIT). Il nuovo sistema ha distinto con successo le lesioni pigmentate sospette SPL dalle lesioni non sospette nelle foto della pelle dei pazienti con una precisione del 90% circa e per la prima volta ha stabilito una metrica “brutto anatroccolo” in grado di eguagliare il consenso di tre dermatologi nell’88% delle volte.

“Forniamo essenzialmente un proxy matematico ben definito per la profonda intuizione su cui fa affidamento un dermatologo per determinare se una lesione cutanea è abbastanza sospetta da giustificare un esame più approfondito”, ha detto il primo autore dello studio Luis Soenksen, Ph.D., Postdoctoral Fellow presso il Wyss Institute che è anche Venture Builder al MIT. “Questa innovazione consente di analizzare rapidamente le foto della pelle dei pazienti per identificare le lesioni che dovrebbero essere valutate da un dermatologo, consentendo uno screening efficace per il melanoma a livello di popolazione”.

Vedi anche:Melanoma: test prevede la risposta all’immunoterapia

La tecnologia è descritta in Science Translational Medicine e il codice sorgente del CDNN è apertamente disponibile su GitHub.

Mettere a fuoco i brutti anatroccoli

Il melanoma è una cosa personale per Soenksen, che ha visto diversi amici intimi e familiari soffrire della malattia. “Mi ha stupito che le persone possano morire di melanoma semplicemente perché i medici di base e i pazienti attualmente non hanno gli strumenti per trovare in modo efficiente “quelli strani “. Ho deciso di affrontare questo problema sfruttando molte delle tecniche che ho imparato dal mio lavoro con l’intelligenza artificiale al Wyss e al MIT “, ha detto.

Soenksen e i suoi collaboratori hanno scoperto che tutti i sistemi CAD esistenti creati per identificare le SPL analizzavano solo le lesioni individualmente, omettendo completamente i criteri del brutto anatroccolo che i dermatologi usano per confrontare diversi nei di un paziente durante un esame. Così hanno deciso di costruirne uno proprio.

Per garantire che il loro sistema potesse essere utilizzato da persone senza formazione specialistica in dermatologia, il team ha creato un database di oltre 33.000 immagini “ad ampio campo” della pelle dei pazienti che includeva sfondi e altri oggetti. Le immagini contenevano sia le SPL che lesioni cutanee non sospette che erano state etichettate e confermate da un consenso di tre dermatologi certificati. Dopo la formazione sul database e il successivo perfezionamento e test, il sistema è stato in grado di distinguere tra lesioni sospette e non sospette con una sensibilità del 90,3% e una specificità dell’89,9%, migliorando i sistemi precedentemente pubblicati.

Ma questo sistema di riferimento stava ancora analizzando le caratteristiche delle singole lesioni, piuttosto che le caratteristiche di più lesioni come fanno i dermatologi. Per aggiungere i criteri del brutto anatroccolo al loro modello, i ricercatori hanno utilizzato le caratteristiche estratte in una fase secondaria per creare una “mappa” 3-D di tutte le lesioni in una data immagine che ha calcolato anche la distanza dal “tipico” di ciascuna lesione. Più una data lesione era “strana” rispetto alle altre in un’immagine, più era lontana dal centro dello spazio tridimensionale. Questa distanza è la prima definizione quantificabile dei criteri del brutto anatroccolo e funge da gateway per sfruttare le reti di apprendimento profondo per superare il compito impegnativo e dispendioso in termini di tempo di identificare e analizzare le differenze tra tutte le lesioni pigmentate in un singolo paziente.

Apprendimento profondo contro dermatologi

Il loro DCNN doveva ancora superare un test finale: il confronto con dermatologi attivi e viventi che avevano il compito di identificare le SPL dalle immagini della pelle dei pazienti. Tre dermatologi hanno esaminato 135 foto ad ampio campo di 68 pazienti e hanno assegnato a ciascuna lesione un punteggio di “stranezza” che indicava quanto fosse preoccupante. Le stesse immagini sono state analizzate e valutate dall’algoritmo. Quando le valutazioni sono state confrontate, i ricercatori hanno scoperto che l’algoritmo concordava con il consenso dei dermatologi l’88% delle volte e con i singoli dermatologi l’86% delle volte.

“Questo alto livello di consenso tra l’intelligenza artificiale e i medici umani è un importante progresso in questo campo, perché l’accordo tra i dermatologi è tipicamente molto alto, intorno al 90%”, ha detto il coautore Jim Collins, Ph.D., a Membro della Core Faculty del Wyss Institute e co-leader della sua Predictive Bioanalytics Initiative, che è anche il Termeer Professor di ingegneria medica e scienza al MIT. “Essenzialmente, siamo stati in grado di ottenere un’accuratezza a livello di dermatologo nella diagnosi di potenziali lesioni del cancro della pelle da immagini che possono essere scattate da chiunque con uno smartphone, il che apre un enorme potenziale per la ricerca e il trattamento precoce del melanoma”.

Riconoscendo che una tale tecnologia dovrebbe essere messa a disposizione di quante più persone possibile per il massimo beneficio, il team ha reso il proprio algoritmo open source su GitHub. I ricercatori sperano di collaborare con centri medici per avviare studi clinici che dimostrino ulteriormente l’efficacia del loro sistema e con l’industria per trasformarlo in un prodotto che potrebbe essere utilizzato dai fornitori di cure primarie in tutto il mondo. Riconoscono anche che per essere universalmente utili, il loro algoritmo deve essere in grado di funzionare altrettanto bene attraverso l’intero spettro di tonalità della pelle umana, che intendono incorporare nello sviluppo futuro.

Fonte:News Medical